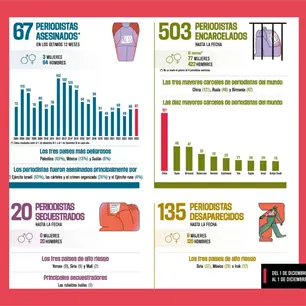

El uso de deepfakes contra periodistas es una amenaza creciente para la libertad de prensa, y tiene un impacto particularmente grave en las mujeres. De acuerdo con un análisis realizado por Reporteros Sin Fronteras (RSF), entre diciembre de 2023 y diciembre de 2025, al menos 100 periodistas fueron víctimas de suplantación digital en 27 países, y el 74% de los casos corresponde a mujeres.

El fenómeno, impulsado por el avance de la inteligencia artificial generativa, incluye desde montajes de audio y video con fines de desinformación hasta campañas de difamación, fraude e intimidación.

En algunos casos, los contenidos manipulados han puesto en riesgo la integridad física de las víctimas o han provocado consecuencias directas en su actividad profesional.

El análisis de RSF revela que los deepfakes no solo son una herramienta de manipulación informativa, sino también una forma de violencia de género.

Del total de mujeres periodistas afectadas, el 13% fue blanco de contenidos pornográficos falsos, utilizados para desacreditarlas, humillarlas o alimentar campañas de acoso.

Estos ataques se suman a un entorno digital de por sí, hostil para las periodistas.

Casos documentados muestran cómo los montajes sexuales o denigrantes suelen difundirse en redes sociales como parte de estrategias coordinadas de intimidación política o ideológica.

Deepfakes abonan a la pérdida de confianza en el periodismo

Además del daño personal, los deepfakes afectan directamente la credibilidad del periodismo. En varios casos analizados, el público creyó auténticos los contenidos falsos, incluso después de que los propios periodistas los desmintieran.

Otros periodistas han enfrentado consecuencias más complejas, como denuncias legales, presiones laborales o una avalancha de mensajes de usuarios engañados por estafas que utilizaban su imagen.

RSF advirtió que los deepfakes son un desafío estructural para el derecho a la información y que las redes sociales actúan como principal canal de difusión, mientras que la trazabilidad de los responsables sigue siendo limitada y la impunidad es la norma.

Ante este escenario, la organización llamó a una respuesta coordinada en tres frentes:

- Que los medios adopten sistemas de certificación de origen y autenticidad de contenidos;

- Que las plataformas identifiquen claramente el material generado por IA;

- Que los marcos legales incorporen sanciones específicas para la creación y difusión de deepfakes maliciosos.